Sophos, líder mundial e innovación y entrega de ciberseguridad como servicio, publica una nueva investigación sobre cómo el sector de la ciberseguridad puede aprovechar GPT-3, el modelo de lenguaje que utiliza ChatGPT, como copiloto para ayudar a derrotar a los ciberatacantes. El informe “La aplicación del procesamiento lingüístico a las ciberdefensas”, explica en detalle varios proyectos llevados a cabo por el equipo de Sophos X-Ops en los que se han utilizado los amplios modelos lingüísticos de GPT-3 para simplificar la búsqueda de actividad maliciosa en conjuntos de datos de software de seguridad, filtrar con mayor precisión el spam y acelerar el análisis de ataques de archivos binarios “living off the land” (LOLBin).

«Desde que OpenAI presentó ChatGPT en noviembre, el sector de la ciberseguridad se ha centrado principalmente en los riesgos potenciales que podría entrañar esta nueva tecnología. ¿Puede la IA ayudar a los aspirantes a ciberatacantes a escribir malware o ayudar a los ciberdelincuentes a escribir correos electrónicos de phishing mucho más convincentes? Tal vez, pero, en Sophos, hace tiempo que vemos la IA como un aliado más que como un enemigo, lo que la convierte en una tecnología fundamental para Sophos, y GPT-3 no es diferente. El sector de la ciberseguridad debería prestar atención no sólo a los riesgos potenciales, sino también a las oportunidades que ofrece GPT-3«, explica Sean Gallagher, investigador principal de amenazas de Sophos.

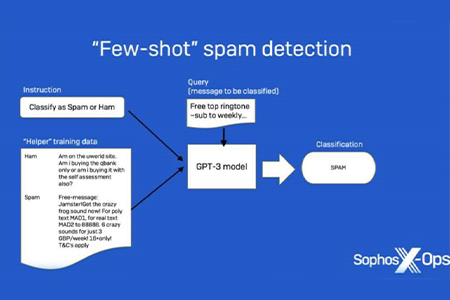

Los investigadores de Sophos X-Ops han estado trabajando en tres proyectos experimentales que demuestran el potencial de GPT-3 como asistente de los profesionales de la ciberprotección, y que podrían ayudar a los expertos en seguridad a encontrar y bloquear actividades maliciosas de forma más eficaz usando los amplios modelos lingüísticos de la familia GPT-3. Los tres proyectos utilizan una técnica llamada “few-shot learning (FSL)”, o aprendizaje en pocos pasos por su traducción aproximada al castellano, que consiste en un marco de Machine Learning que permite entrenar el modelo de IA con solo unas pocas muestras de datos. Este modelo permite al algoritmo generalizar sobre nuevas categorías de datos, aunque nunca las haya visto antes, usando solo unas pocas muestras de datos, lo que reduce la necesidad de recopilar un gran volumen de datos preclasificados.

Proyecto 1: Interfaz de consulta en lenguaje natural para buscar actividad maliciosa

La primera aplicación que Sophos ha probado con el método de aprendizaje “few-shot learning” es una interfaz de consulta en lenguaje natural para filtrar actividad maliciosa en la telemetría XDR (que son todos los datos que recopilan el software de seguridad sobre el funcionamiento de sus soluciones: email, endpoint, servidores, firewall, la nube, etc). En concreto, Sophos ha puesto a prueba el modelo con su producto EDR (endpoint protection and response). La interfaz, basada en GPT, toma comandos escritos en inglés sencillo, por ejemplo: “Muéstrame todos los procesos que se han llamado powershell.exe y han sido ejecutados por el usuario root” (también llamado superusuario, una cuenta con privilegios de acceso total y sin restricciones). Con estos comandos genera consultas XDR-SQL, sin que el usuario necesite entender la estructura subyacente de la base de datos ni el propio lenguaje SQL.

Los modelos de GPT-3 pueden ajustarse con el tiempo a medida que se poseen más datos, aplicando un proceso acumulativo en que el no es necesario volver a ejecutar todo desde cero cada vez que se incluyen más datos de entrenamiento. El modelo más amplio creado por Sophos para este proyecto ha dado respuestas precisas en más del 80% de los casos al tratar preguntas en lenguaje natural que utilizaban datos que había visto como parte del entrenamiento, y en el 70,5% de las veces al tratar preguntas que incluían datos que el modelo no había visto antes. A pesar de que actualmente estos modelos son un experimento, se prevé el uso de sus capacidades en futuras versiones de productos de Sophos.

Proyecto 2: Detector de spam basado en GPT

El Machine Learning ya se ha aplicado con anterioridad a la detección de spam utilizando diferentes tipos de modelo. Sin embargo, Sophos ha probado un nuevo filtro de spam usando ChatGPT y descubrió que, en comparación con otros modelos, el filtro de GPT-3 es significativamente más preciso y supera con creces otros métodos de Machine Learning tradicionales cuando la cantidad de datos utilizada para el entrenamiento es pequeña.

Proyecto 3: Herramienta para analizar líneas de comandos ejecutados en archivos binarios “living of the land” (LOLBin)

Por último, los investigadores de Sophos han creado un programa para simplificar el proceso de ingeniería inversa de las líneas de comandos de LOLBins. Para los desarrolladores y expertos, este tipo de ingeniería inversa es difícil de realizar, ya que incluye mucha confusión y son códigos largos y difíciles de analizar; pero también resulta fundamental hacerlo para comprender el comportamiento de LOLBins y frenar este tipo de ataques.

Las ventajas que aporta ChatGPT es que puede escribir líneas de código en varios lenguajes de programación y scripting cuando se le da una entrada en lenguaje natural. Pero también es posible entrenarle para hacer lo contrario: generar descripciones analíticas a partir de líneas de comandos o fragmentos de código. Para obtener la descripción más precisa de GPT-3, el equipo de SophosAI utilizó un enfoque llamado retrotraducción, un proceso en el que los resultados de una traducción de una cadena de comandos a lenguaje natural se devuelven a GPT-3 para traducirlos de nuevo a cadenas de comandos de código y compararlos con el original. Este proceso puede generar información complementaria y ayudar en análisis más complejos.

“Una de las preocupaciones crecientes en los centros de operaciones de seguridad es la enorme cantidad de ‘ruido’ que llega. Hay demasiadas notificaciones y detecciones que analizar, y muchas empresas cuentan con recursos limitados. Hemos demostrado que, con herramientas como GPT-3, podemos simplificar ciertos procesos que requieren mucho trabajo y proporcionar un tiempo valioso a los expertos en seguridad. Ya estamos trabajando en la incorporación de algunos de los experimentos anteriores a nuestros productos, y hemos puesto los resultados de nuestros proyectos a disposición de los interesados en probar GPT-3 en sus propios entornos de análisis en nuestro GitHub. En el futuro, creemos que GPT-3 puede convertirse en un copiloto habitual para los expertos en seguridad«, afirma Gallagher.